Las gafas inteligentes más populares del mundo acaban de volverse mucho más listas. Meta ha lanzado una actualización revolucionaria para las Ray-Ban Meta, introduciendo tres funciones que cambian por completo la forma en que interactuamos con el mundo: escritura manual neuronal, subtítulos en vivo y una capacidad de análisis visual sin precedentes.

Lo que empezó como un accesorio de moda se ha transformado, de la noche a la mañana, en el dispositivo de asistencia personal más avanzado del mercado.

Escritura Manual Neuronal: De tus dedos a la IA

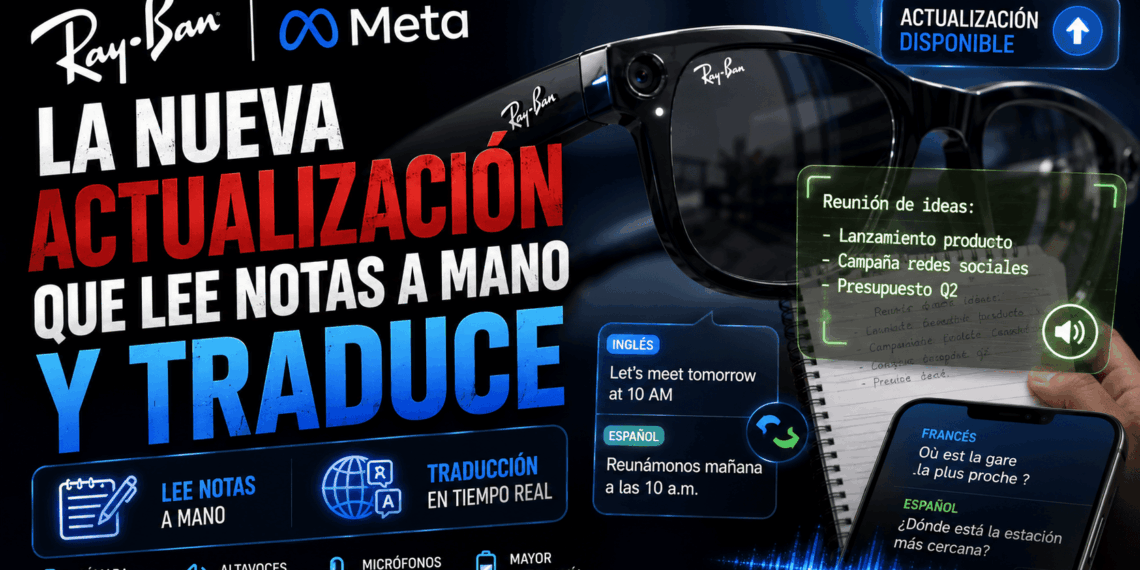

La función más impactante es, sin duda, la capacidad de las gafas para interpretar la escritura manual. Gracias a una red neuronal avanzada, las gafas pueden:

- Digitalizar notas: Simplemente mira un papel donde hayas escrito a mano y Meta AI podrá transcribirlo a texto digital, enviarlo por correo o resumir tus apuntes.

- Reconocimiento de gestos: Las gafas ahora detectan movimientos sutiles de la mano para ejecutar comandos, permitiendo una interacción mucho más natural sin necesidad de tocar la montura.

Subtítulos en vivo y traducción instantánea

Otra de las grandes novedades son los Live Captions. Si estás viendo un vídeo o hablando con alguien en otro idioma, las gafas (a través de la aplicación Meta View) pueden generar subtítulos en tiempo real.

Esta función es un avance masivo para la accesibilidad, permitiendo a personas con dificultades auditivas o en entornos ruidosos seguir una conversación con apoyo visual instantáneo de lo que captan los micrófonos direccionales de las gafas.

Multimodalidad: Siri y Google tienen un problema

Con esta actualización, el asistente de las Ray-Ban Meta se vuelve totalmente multimodal. Esto significa que puedes mirar un monumento, una planta o un ingrediente de cocina y preguntar: «Oye Meta, ¿qué es esto y qué puedo hacer con ello?». La velocidad de respuesta se ha reducido drásticamente, haciendo que la experiencia de «asistente visual» sea fluida y útil en el día a día.